De Texte à Image avec un Générateur d'Art par IA

L'art simplifié par IA avec Stable Diffusion Online

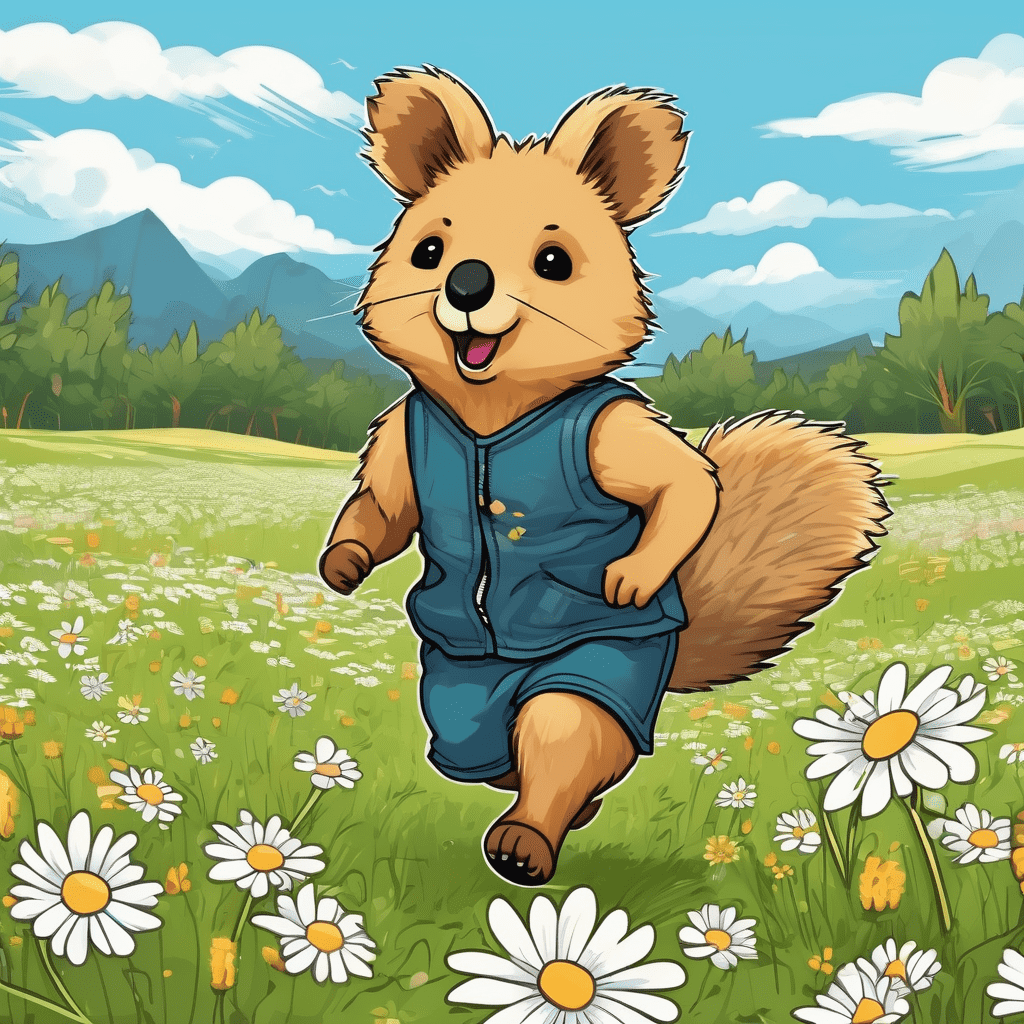

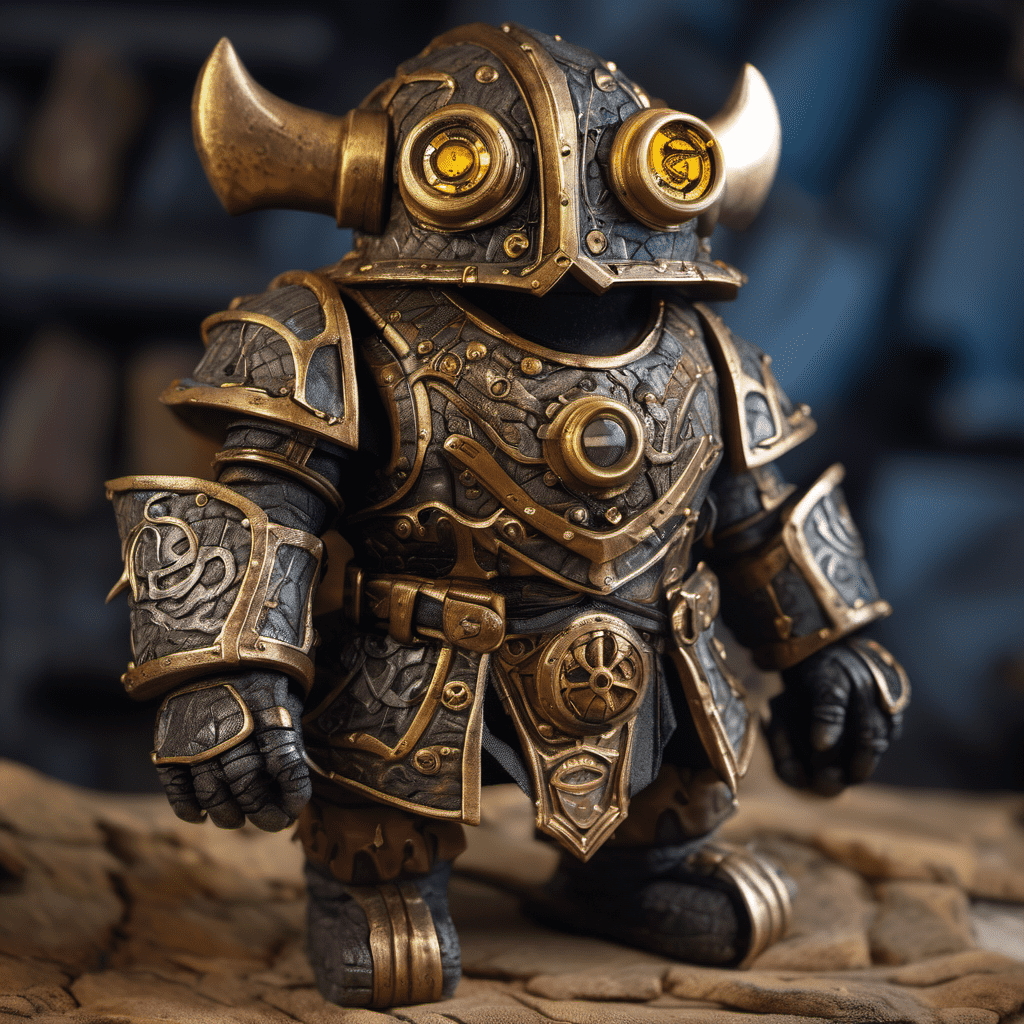

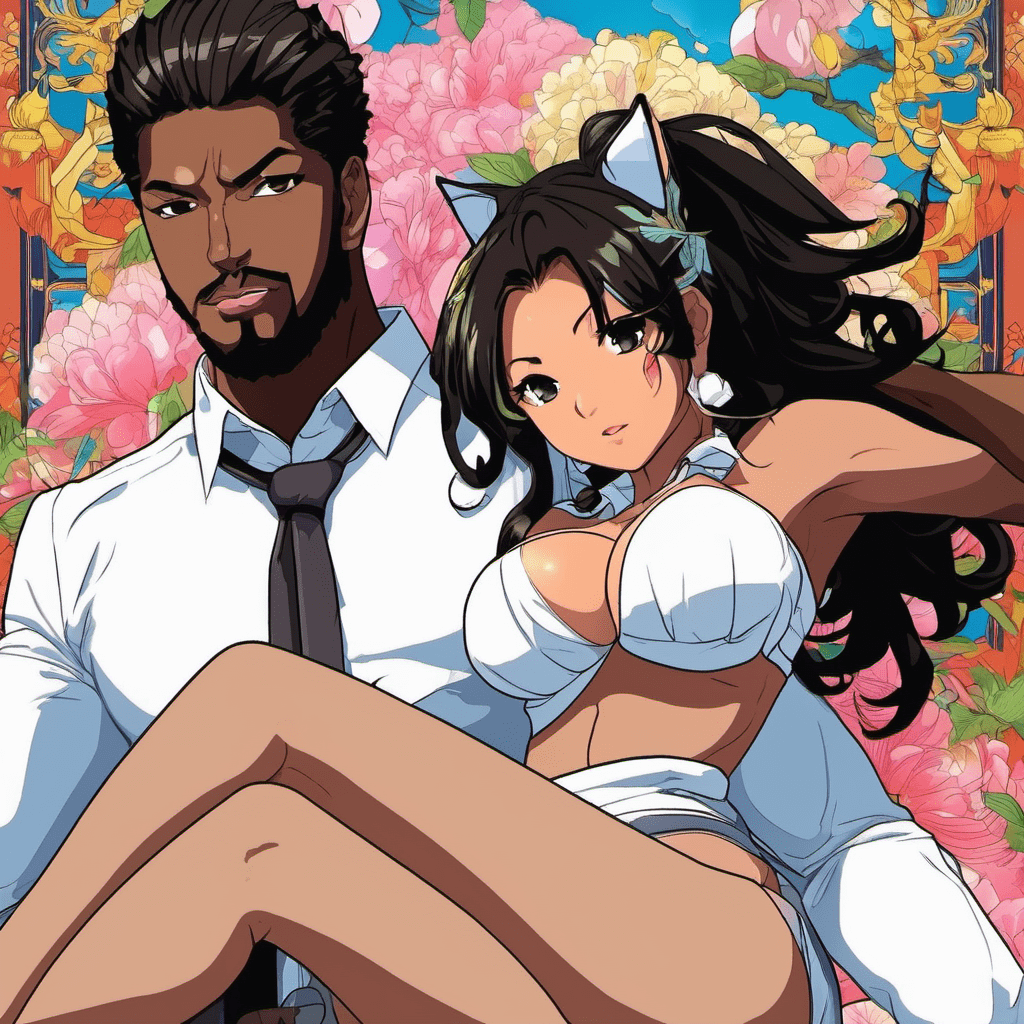

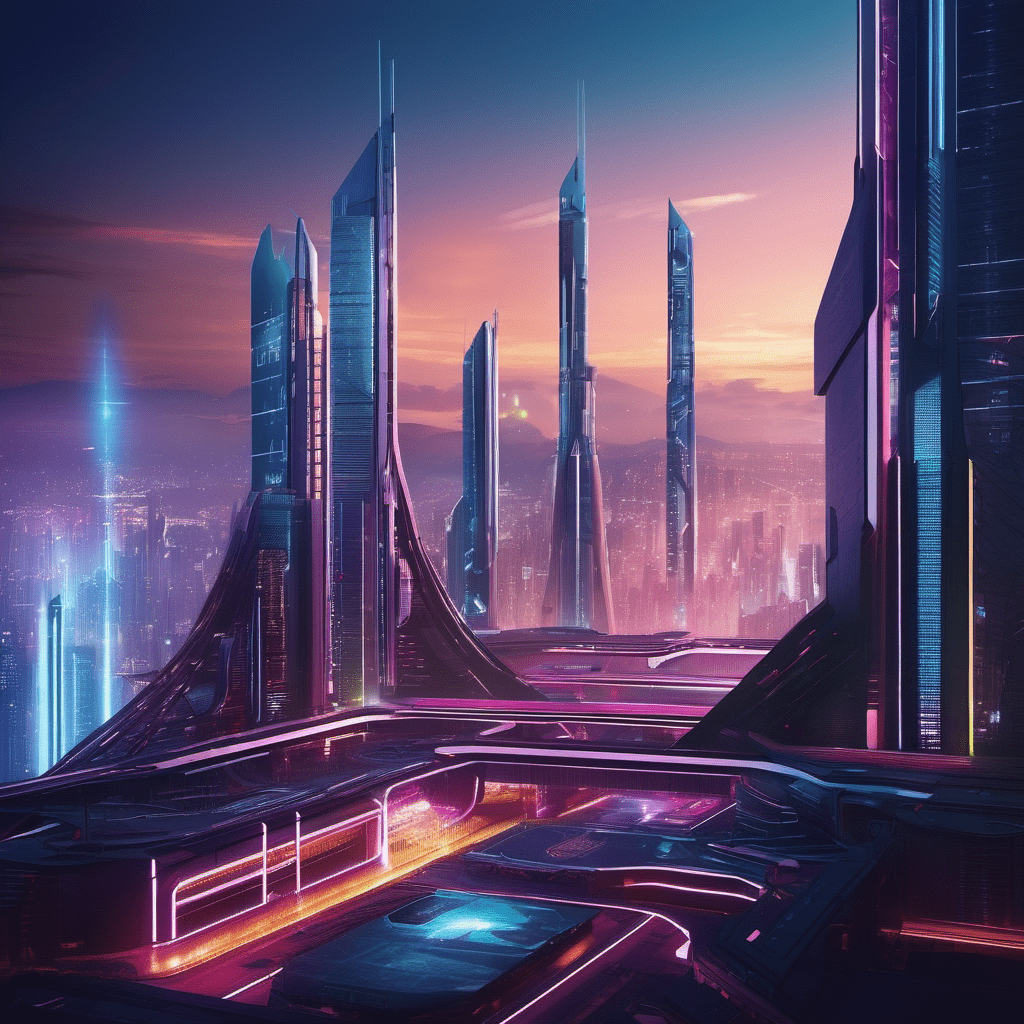

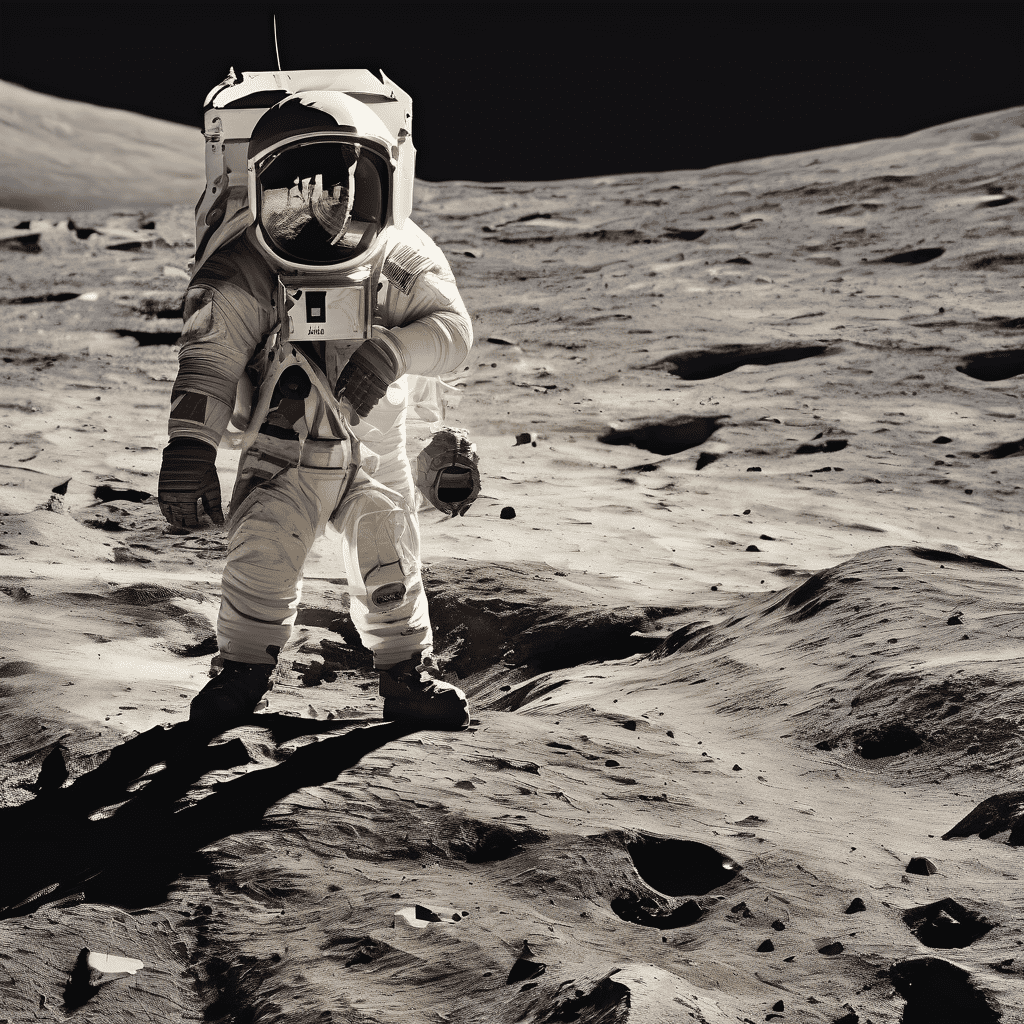

Stable Diffusion Online révolutionne la création d'art par IA, offrant une plateforme facile à utiliser, autant pour les débutants que pour les experts. L'outil idéal pour explorer la génération d'images par IA sans avoir besoin de connaissances techniques approfondies. L'interface est conçue pour être intuitive, permettant aux utilisateurs de donner vie rapidement à leurs idées en visuels percutants. Ce n'est pas qu'un simple générateur d'images par IA ; c'est un lien entre créativité et technologie, garantissant que le processus de création artistique reste à la fois agréable et accessible. Que vous découvriez l'art numérique pour la première fois ou que vous soyez un artiste chevronné, Stable Diffusion Online donne vie à vos visions sans effort, en faisant une solution incontournable pour la création artistique en ligne par IA.

Sublimez Votre Art avec le Générateur d'Images AI Stable Diffusion

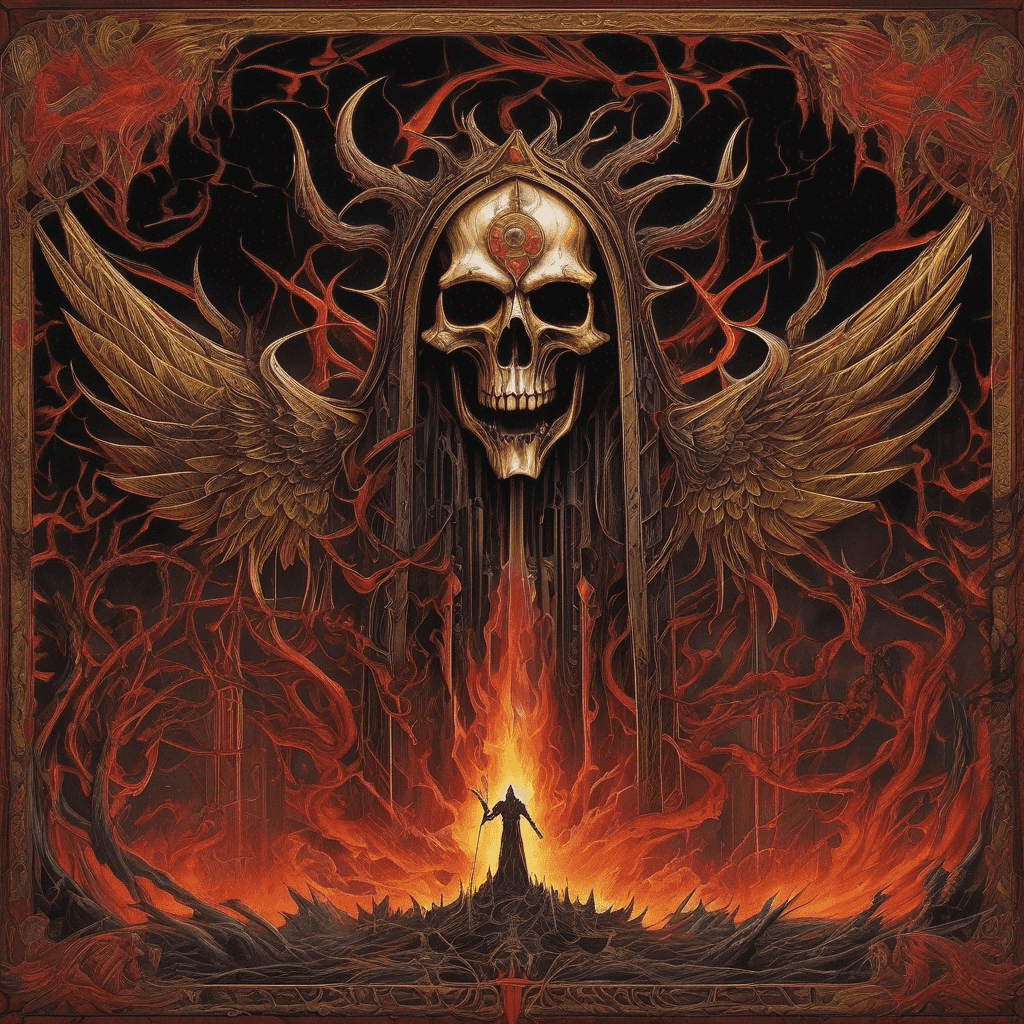

Le Générateur d'Images AI Stable Diffusion est un outil incontournable pour les artistes et les designers, conçu pour produire des images complexes, détaillées et de haute qualité. Idéal pour ceux qui souhaitent intégrer l'IA dans leur processus créatif, il offre un niveau de détail et de personnalisation inégalé. Plus qu'un simple outil de diffusion stable AI, c'est un allié précieux dans la création, capable de donner vie à des paysages réalistes, des designs complexes et de l'art conceptuel avec précision. Que ce soit pour le marketing digital ou des projets personnels, ce générateur d'images AI facilite la création d'œuvres uniques et impressionnantes. Le Générateur d'Images AI Stable Diffusion se distingue par sa capacité à gérer des visions artistiques complexes, en faisant un outil incontournable pour quiconque cherche à tirer parti du potentiel de l'AI Diffusion dans leur art.

Art AI en Haute Résolution avec Stable Diffusion XL en Ligne

Stable Diffusion XL en Ligne élève la création artistique assistée par IA à de nouveaux sommets, en se concentrant sur des images en haute résolution et détaillées. Cette plateforme est spécialement conçue pour des projets de qualité professionnelle, fournissant une qualité exceptionnelle pour l'art numérique et le design. Spécialisée dans les rendus en ultra-haute résolution, elle est l'outil idéal pour produire des œuvres d'art à grande échelle et des pièces numériques détaillées. Stable Diffusion XL en Ligne est bien plus qu'un simple outil en ligne de Stable Diffusion; c'est une porte d'entrée vers l'exploration de vastes possibilités créatives avec l'IA. Elle excelle à transformer des idées complexes en chefs-d'œuvre visuels de haute qualité, parfaits pour les projets commerciaux et artistiques. Adoptez l'avenir de la création artistique AI en haute résolution avec Stable Diffusion XL en Ligne, où chaque détail est rendu avec une clarté et une précision saisissantes.

Modèle Stable Diffusion XL

Stable Diffusion XL 1.0 (SDXL) est la dernière version du système de génération d'images par IA, Stable Diffusion, créé par Stability AI et sorti en juillet 2023. SDXL introduit des améliorations majeures par rapport aux versions précédentes grâce à son système de modèle double à 6 milliards de paramètres, permettant une résolution de 1024x1024, une génération d'images hautement réaliste, la génération de texte lisible, une saisie simplifiée avec moins de mots, et des styles prédéfinis intégrés. Stable Diffusion XL représente une avancée majeure en termes de qualité, de flexibilité et de potentiel créatif dans la génération d'images par IA par rapport aux versions antérieures de Stable Diffusion.

Qu'est-ce que Stable Diffusion AI

Stable Diffusion est un système d'IA en open-source pour générer des images réalistes et éditer des images existantes. Il utilise un modèle d'apprentissage profond entraîné sur des millions de paires d'images et de textes. À partir d'un prompt textuel, Stable Diffusion crée des images correspondant à cette description. Les utilisateurs peuvent y accéder via des sites internet comme Stablediffusionai.ai ou l'exécuter localement. Stable Diffusion représente une avancée majeure dans la génération d'images par IA accessible au public. Malgré des limitations comme les biais des données d'entraînement, il offre aux artistes et créateurs de contenu une liberté créative sans précédent. Utilisé de manière responsable, Stable Diffusion ouvre des possibilités passionnantes pour l'art, les médias, et bien plus encore.

Comment utiliser Stable Diffusion AI

Stable Diffusion est un générateur d'images par IA. Pour l'utiliser, rendez-vous sur stablediffusionai.ai. Entrez un texte descriptif de l'image que vous souhaitez créer. Ajustez les paramètres tels que la taille de l'image et le style. Cliquez sur « Dream » pour créer des images. Sélectionnez votre image préférée et téléchargez-la ou partagez-la. Affinez les descriptions textuelles et les paramètres pour obtenir les résultats souhaités. Vous pouvez également éditer les images avec les fonctionnalités d'inpainting et d'outpainting. Stable Diffusion offre une grande liberté créative lorsqu'il est utilisé avec soin.

Comment télécharger l'IA Stable Diffusion

Stable Diffusion est disponible sur GitHub. Pour le télécharger, rendez-vous sur github.com/CompVis/stable-diffusion et cliquez sur le bouton vert "Code". Cliquez sur « Download ZIP » pour télécharger le code source et les paramètres du modèle. Décompressez le fichier ZIP après l'avoir téléchargé. Vous aurez besoin d'au moins 10 Go d'espace disque libre. Pour utiliser Stable Diffusion, vous aurez également besoin de Python et d'un GPU avec au moins 4 Go de VRAM. Sinon, vous pouvez accéder à Stable Diffusion via des sites comme Stablediffusionai.ai sans l'installer localement. Stable Diffusion offre un accès inédit à un puissant générateur d'images IA. Téléchargez-le pour libérer votre créativité.

Comment installer l'IA Stable Diffusion ?

Pour installer Stable Diffusion, vous avez besoin d'un PC avec Windows 10 ou 11 et d'un GPU avec au moins 4 Go de VRAM. Python doit également être installé. Téléchargez et extrayez le dépôt de code Stable Diffusion. Récupérez le fichier de point de contrôle du modèle pré-entraîné ainsi que le fichier de configuration et placez-les dans les dossiers appropriés. Exécutez le fichier webui-user.bat pour lancer l'interface web. Vous pouvez maintenant générer des images en tapant des instructions textuelles. Ajustez les paramètres tels que les étapes d'échantillonnage et d'inférence. Installez des extensions comme Automatic1111 pour ajouter des fonctionnalités supplémentaires. Avec la bonne configuration, vous pouvez exécuter localement ce puissant générateur d'images IA.

Comment entraîner l'IA Stable Diffusion ?

Pour entraîner votre propre modèle Stable Diffusion, vous avez besoin d'un jeu de données d'images et de textes associés, d'un GPU avec au moins 4 Go de VRAM, et de compétences techniques. Tout d'abord, préparez et nettoyez vos données d'entraînement. Ensuite, modifiez les fichiers de configuration de Stable Diffusion pour pointer vers votre jeu de données. Définissez les hyperparamètres comme la taille du lot et le taux d'apprentissage. Lancez les scripts d'entraînement pour entraîner le VAE, UNet et l'encodeur de texte séparément. L'entraînement demande une puissance de calcul intensive, alors envisagez de louer une instance GPU cloud si nécessaire. Surveillez la progression de l'entraînement. Après l'entraînement, évaluez les performances du modèle. Ajustez-le au besoin jusqu'à ce que vous soyez satisfait. Avec du temps, de la puissance de calcul et des efforts, vous pouvez personnaliser Stable Diffusion selon vos besoins spécifiques.

Qu'est-ce que Lora dans Stable Diffusion

Lora, pour 'Learned Regional Augmentation', est une technique pour améliorer les modèles de Stable Diffusion. Les Loras sont des petits réseaux neuronaux entraînés sur des ensembles de données d'images pour spécialiser un modèle dans la génération de détails précis tels que les visages, les mains ou les vêtements. Pour utiliser un Lora, téléchargez-le et mettez-le dans le bon dossier. Dans vos prompts, ajoutez le mot-clé de Lora pour l'activer. Les Loras permettent un meilleur contrôle des détails sans réentraîner le modèle entier. Ils permettent de personnaliser Stable Diffusion pour générer des personnages d'anime, des portraits, des mannequins de mode, et bien plus encore. Avec les bons Loras, vous pouvez amener Stable Diffusion à un niveau supérieur de détail et de personnalisation.

Qu'est-ce qu'un prompt négatif dans l'IA Stable Diffusion

Dans Stable Diffusion, les prompts négatifs vous permettent de définir ce que vous ne voulez pas dans une image générée. Ce sont simplement des mots ou des phrases qui disent au modèle quoi éviter. Par exemple, ajouter "mal dessiné, laid, doigts supplémentaires" comme prompt négatif réduit la probabilité que ces éléments indésirables n'apparaissent. Les prompts négatifs permettent un meilleur contrôle du processus de génération d'images. Ils sont utiles pour exclure des défauts courants comme les distorsions ou les artefacts. Spécifier des prompts négatifs en combinaison avec les prompts positifs aide à orienter le modèle vers le résultat souhaité. Une utilisation efficace des prompts négatifs améliore la qualité et la précision des images générées par Stable Diffusion.

Stable Diffusion nécessite-t-elle une connexion Internet ?

Stable Diffusion peut fonctionner totalement hors ligne une fois installée localement. La seule connexion Internet requise est pour télécharger initialement le code source et les fichiers du modèle. Après la configuration, vous pouvez générer des images via l'interface web locale sans connexion Internet. Stable Diffusion effectue les inférences directement sur votre GPU local, offrant ainsi plus de confidentialité et de sécurité par rapport aux services basés sur le cloud. Cependant, accéder à Stable Diffusion sur les sites web requiert une connexion Internet continue. En l’exécutant localement, vous évitez cela, ce qui permet une utilisation en vol, dans des zones éloignées ou partout où l’accès à Internet est limité. Ainsi, bien que l'accès via le web nécessite Internet, Stable Diffusion elle-même n'exige pas de connexion en ligne lorsqu'elle est auto-hébergée.

Guide d'utilisation des embeddings Stable Diffusion IA

Les embeddings permettent aux modèles de Stable Diffusion de générer des images imitant un style visuel spécifique. Pour utiliser des embeddings, commencez par les entraîner sur un ensemble de données d'images représentant le style souhaité. Déposez le fichier d'embedding dans le dossier approprié. Dans votre prompt, ajoutez le nom de l'embedding entre crochets comme ceci [:Nom:] pour l'activer. Stable Diffusion générera des images correspondant à ce style. Ajustez le paramètre de force pour contrôler l'effet. Les embeddings sont très efficaces pour garantir des résultats cohérents. Avec les bons embeddings, vous pouvez personnaliser Stable Diffusion pour des œuvres d'art spécifiques, des esthétiques particulières, et autres styles visuels.

Questions Fréquemment Posées

Que sont 'Stable difusion' et 'Stable difussion' ?

'Stable difusion' et 'Stable difussion' sont des erreurs typographiques pour 'Stable Diffusion'. Ces termes ne désignent aucune plateforme distincte. 'Stable Diffusion' est le terme correct pour l'outil de génération d'art par IA, connu pour transformer du texte en images. Ces fautes sont fréquentes mais se réfèrent à la même technologie.

Quelle est la relation entre Stability Diffusion XL et Stable Diffusion ?

Stability Diffusion XL est une version avancée de Stable Diffusion, spécialisée dans la création d'images haute résolution. Alors que Stable Diffusion se concentre sur l'art généré par IA, Stability Diffusion XL améliore cet aspect avec plus de détails et de clarté, idéal pour des projets professionnels de haute qualité.

Introduction à Stable Diffusion

Stable Diffusion est un outil open-source de génération d'images à partir de texte basé sur des modèles de diffusion, développé par le groupe CompVis de l'Université Ludwig-Maximilians de Munich et Runway ML, avec le soutien informatique de Stability AI. Il peut générer des images de haute qualité à partir de descriptions textuelles et peut également effectuer du inpainting, du outpainting et de la traduction d'images guidée par le texte. Stable Diffusion a rendu open source son code, ses modèles préentraînés et sa licence, permettant aux utilisateurs de l'exécuter sur un seul GPU. Cela en fait le premier modèle de génération d'images par texte en profondeur open-source pouvant être exécuté localement sur les appareils des utilisateurs.

Comment fonctionne Stable Diffusion ?

Stable Diffusion utilise une architecture de modèle de diffusion appelée Modèles de Diffusion Latente (LDM). Elle se compose de 3 composants : un autoencodeur variationnel (VAE), un U-Net et un encodeur de texte optionnel. Le VAE compresse l'image de l'espace pixel à un espace latent plus petit, capturant des informations sémantiques plus essentielles. Un bruit gaussien est ajouté de manière itérative au latent compressé pendant la diffusion avant. Le bloc U-Net (composé d'une colonne vertébrale ResNet) débruite la sortie de la diffusion avant pour obtenir une représentation latente. Enfin, le décodeur VAE génère l'image finale en convertissant la représentation en espace pixel. La description textuelle est exposée aux U-Nets de débruitage via un mécanisme d'attention croisée pour guider la génération d'images.

Données d'entraînement pour Stable Diffusion

Stable Diffusion a été entraîné sur le dataset LAION-5B, qui contient des paires image-texte extraites de Common Crawl. Les données ont été classées par langue et filtrées en sous-ensembles avec une résolution plus élevée, moins de probabilités de filigranes et des scores 'esthétiques' prévus plus élevés. Les dernières phases d'entraînement ont également abandonné 10 % du conditionnement texte pour améliorer la Guidance de Diffusion Sans Classificateur.

Capacités de Stable Diffusion

Stable Diffusion peut générer de nouvelles images à partir de zéro en fonction de prompts textuels, redessiner des images existantes pour incorporer de nouveaux éléments décrits dans le texte et modifier des images existantes via l'inpainting et l'outpainting. Il prend également en charge l'utilisation de 'ControlNet' pour changer le style et la couleur de l'image tout en préservant la structure géométrique. L'échange de visage est également possible. Ces fonctionnalités offrent une grande liberté créative aux utilisateurs.

Accéder à Stable Diffusion

Les utilisateurs peuvent télécharger le code source pour configurer Stable Diffusion localement, ou accéder à son API via le site officiel Dream Studio. Dream Studio offre une interface simple et intuitive ainsi que divers outils de configuration. Les utilisateurs peuvent également accéder à l'API Stable Diffusion via des sites tiers comme Hugging Face et Civitai, qui fournissent différents modèles Stable Diffusion pour divers styles d'image.

Limitations de Stable Diffusion

Une limitation majeure de Stable Diffusion est le biais dans ses données d'entraînement, qui proviennent principalement de pages web en anglais. Cela entraîne des résultats biaisés vers la culture occidentale. Il a également des difficultés à générer des membres humains et des visages. Certains utilisateurs ont également signalé que Stable Diffusion 2 fonctionne moins bien que la série Stable Diffusion 1 pour représenter des célébrités et des styles artistiques. Cependant, les utilisateurs peuvent étendre les capacités du modèle en affinant le modèle.

,%20(Masterfully%20crafted%20Glow),%20hyper%20details,(delicate%20detailed).png)

%20as%20Harley%20Quinn%20(DC%20Comics).png)

);%20blue%20eyes.png)